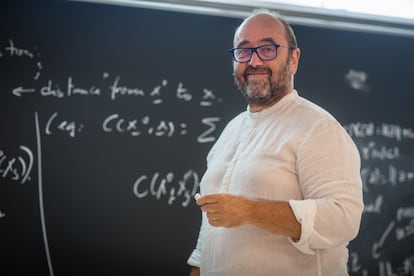

Emilio Carrizosa, matemático: “El liderazgo de la inteligencia artificial no lo tienen ahora mismo los gobiernos, sino empresas privadas”

El investigador de la Universidad de Sevilla ha sido premiado por la Sociedad de Estadística y la Fundación BBVA por la aplicación de fórmulas a la resolución de problemas de la vida cotidiana

A Emilio Carrizosa, cordobés de 58 años, le apasionan las matemáticas desde pequeño, le parecían “un ejercicio mental muy interesante”. Pero frente a esa devoción veía siempre la distante orilla de la vida cotidiana, lo que le llevó a buscar un puente entre los números y su aplicación en la resolución de problemas. Duda si fue “un flechazo o una revelación mística”, pero encontró el enlace en la investigación operativa, que define como “esa disciplina que ayuda a decidir con recursos limitados”. Ha participado en investigaciones sobre índices climáticos de las sequías, estadísticas de personas sin hogar, diagnóstico del cáncer o cuál es el camino más iluminado para volver a casa de noche a partir de la distancia efectiva del reconocimiento facial.

Saltó del pupitre de alumno a la mesa de profesor de la Facultad de Matemáticas de la Universidad de Sevilla, donde ha podido conjugar su inquebrantable vocación docente (es hijo de dos maestros de Primaria) con la pasión por investigar. Sus trabajos en matemática aplicada y en ciencia de datos han sido premiados por la Sociedad de Estadística y la Fundación BBVA.

Pregunta. ¿Le obsesiona llevar las matemáticas a la vida cotidiana?

Respuesta. Me divertía mucho con el reto intelectual que suponían las matemáticas, hasta que, a mitad de carrera, tuve algunas asignaturas que tenían una componente más aplicada, donde se intuía lo que habían sido las matemáticas en otros tiempos, cuando eran una herramienta para resolver problemas. Entonces empecé a cursar estadística y optimización matemática con la intención de no quedarme solo en el ejercicio intelectual, que era fascinante y lo sigue siendo, sino también de dar un paso más, que esas cosas que yo aprendía pudieran servir como reglas para un nuevo juego, para intentar modelar la realidad e intentar, de alguna manera, participar en la ayuda a la toma de decisiones. Podríamos decir que sí, que es un poco una obsesión que se ha acrecentado con la inteligencia artificial, con la que parece que la ciudadanía está cediendo el derecho a decidir informadamente y delegamos en una máquina que toma las decisiones por nosotros. Esta, igual acierta más veces que un humano porque, entre otras cosas, ha tenido una base de datos para aprender que está en muchos órdenes de magnitud por encima de la que un humano puede manejar, pero al mismo tiempo conlleva una serie de vicios que no controlamos.

P. ¿Los datos despejan la incertidumbre?

R. No, pero ayudan a controlarla. La incertidumbre no voy a poder eliminarla, pero sí voy a tener una idea bastante precisa de qué cabe que me encuentre mañana. Igual no puedo saber si va a llover o no, pero sí puedo saber la probabilidad de que mañana llueva y, en función de eso, tomar las decisiones. La matemática, cuando se aplica, se fundamenta en modelos donde la clave es la relación entre los distintos ingredientes y un par de parámetros por ahí sueltos. Los modelos recogen un montón de información para reducir la incertidumbre. No puedo predecir que esto va a ocurrir, pero sí puedo, por ejemplo, tener unas buenas estimaciones de las probabilidades de que cada cosa ocurra y tenerlo en cuenta para tomar una decisión compatible o coherente con la información que estamos sacando de los datos.

No puedo predecir que esto va a ocurrir, pero sí puedo, por ejemplo, tener unas buenas estimaciones de las probabilidades de que cada cosa ocurra y tenerlo en cuenta para tomar una decisión compatible o coherente con la información que estamos sacando de los datos

P. Si los datos son el ingrediente, ¿qué es el algoritmo?

R. Sería la receta. El algoritmo es como una receta para hacer un puchero para el que vas echando los ingredientes en un determinado orden.

P. Y siguiendo con ese símil, ¿qué son los sesgos?

R. Cuando me han dicho que la carne era de primera y era de segunda o que los garbanzos eran tiernísimos y que no iban a dejar el pellejo. Es un reto importantísimo porque el sesgo existe y, con la inteligencia artificial, no sabemos cómo han aprendido esas herramientas. Seguramente han bebido de todos los sesgos existentes que, a veces, son inocentes, pero otras veces conllevan discriminación de personas. Es un peligro que afortunadamente las matemáticas pueden detectar, corregir o reducir. Volviendo al símil de los garbanzos, sería ponerlos en agua un buen tiempo para que estén blanditos. Los sesgos son un problema altamente preocupante. La inteligencia artificial ahora mismo nos plantea muchos retos en positivo y es una herramienta bastante democrática en el sentido de que no tienes que estar en el grupo de los elegidos para poder usarla, pero el peligro al que nos enfrentamos es la posible falta de transparencia y equidad para la toma de decisiones. El ejemplo más famoso es el programa para ayudar a los jueces a determinar la libertad provisional de un acusado. Si eras afroamericano, te dejaba en la cárcel y si era caucásico, con una altísima probabilidad, te decía “usted no va a reincidir, salga a la calle”. Además, no podemos perder de vista que el liderazgo de la inteligencia artificial no lo tienen ahora mismo los gobiernos, sino empresas privadas que miran su interés comercial. No sabemos quién está decidiendo por nosotros.

P. ¿Hay decisiones que no se deben dejar a la inteligencia artificial?

R. Hay ciertas pruebas diagnósticas médicas, por ejemplo, basadas en imagen, donde la máquina es capaz de detectar un cáncer en una fase previa mejor que el especialista. Puede ser, por lo tanto, una herramienta de ayuda a la toma de decisiones, pero a mí me gustaría que la decisión última la tomara una persona con conciencia, a la que yo pudiera mirar a los ojos en el caso de que se equivoque, que pudiera decir que lo siente porque tenga moral.

P. Porque los datos no tienen moral.

R. Los datos son a fin de cuenta ceros y unos dentro del ordenador y reflejan una realidad, pero es como hablar de la moral de un cuchillo: puedo usarlo para comer o para agredir a alguien. Los datos son neutros, pero no el uso que podemos hacer de ellos. Y no podemos pensar que empresas privadas o un Gobierno ajeno van a hacer un uso neutro de los datos cuando están ayudándonos a la toma de decisión. Me puedo fiar del criterio de un médico que me haga un diagnóstico, pero si ese médico tiene un interés comercial en el diagnóstico que me está dando, igual debería tomármelo con mucha precaución. Es un problema que tenemos con la toma de decisiones basada en datos, con si la última palabra la sigue teniendo la máquina y no alguien con alma.

P. ¿La IA puede predecir una dana como la de Valencia?

R. Ese es otro tema, el de los fenómenos raros no estacionarios. No tenemos una muestra suficiente como para poder predecir con certeza el resultado. Estamos hablando de fenómenos para los que no tenemos datos similares o idénticos a los que queremos estudiar sino solo parecidos y ahí podemos tener un sesgo que igual no podemos controlar y que es determinante en el fenómeno.

P. Tampoco se puede predecir la criminalidad.

R. Trabajo con un grupo de la Universidad de Chile que colabora con los carabineros de Chile haciendo mapas de intensidad de crímenes para poder predecir y tomar la decisión de dónde hay que patrullar más o menos, para poder conocer cómo de probable es que haya más crímenes.

P. Pero si se aplican los datos, por ejemplo, a las becas, la máquina puede decidir quitarlas donde haya más abandono escolar, donde es fundamental invertir recursos.

R. Por eso es tan importante la transparencia de los procedimientos y que la clase política sea consciente de que la toma de decisiones tiene que ser transparente, de cuáles son las reglas de juego cuando se están dedicando recursos desde las Administraciones Públicas. Me gustaría ver, objetivamente, cuál es la función que han intentado optimizar cuando han tomado una decisión. Le estamos exigiendo a las máquinas una transparencia que después no le exigimos a las personas que utilizan los datos para tomar decisiones.

P. ¿Cuál es el algoritmo más necesario para la sociedad?

R. El reto pendiente en las sociedades occidentales, y desgraciadamente no parece que apuntemos del todo en esa dirección, es un algoritmo con unos criterios transparentes para la distribución de los recursos. Nos hablan siempre de la renta per cápita y a mí no me interesa. Eso es una media. Si un magnate multimillonario y yo vivimos en la misma aldea, esta va a tener una renta per cápita altísima cuando el magnate tiene el 99,99% de todo.

P. ¿Las matemáticas podrían prevenir el fraude?

R. Lo hacen. De hecho, los mecanismos de predicción en ese sentido son bien sencillos, se puede detectar con mecanismos estadísticos de los ochenta. Los auditores no van a ciegas. Ahora se puede predecir con cierto tino cuándo una transacción es fraudulenta. En un taller, en función del número de empleados que tiene, las horas de alta Seguridad Social, la luz empleada, el agua consumida y el material que ha comprado, por ejemplo, es fácil hacer una predicción de cuánto ha facturado realmente.

P. ¿Pero se vulnera la privacidad?

R. Es un problema sobre el que tenemos que decidir como ciudadanía: hasta qué punto estoy dispuesto a ceder información, como pacto social, para sentirnos más seguros y tener un mundo más justo.

Tu suscripción se está usando en otro dispositivo

¿Quieres añadir otro usuario a tu suscripción?

Si continúas leyendo en este dispositivo, no se podrá leer en el otro.

FlechaTu suscripción se está usando en otro dispositivo y solo puedes acceder a EL PAÍS desde un dispositivo a la vez.

Si quieres compartir tu cuenta, cambia tu suscripción a la modalidad Premium, así podrás añadir otro usuario. Cada uno accederá con su propia cuenta de email, lo que os permitirá personalizar vuestra experiencia en EL PAÍS.

¿Tienes una suscripción de empresa? Accede aquí para contratar más cuentas.

En el caso de no saber quién está usando tu cuenta, te recomendamos cambiar tu contraseña aquí.

Si decides continuar compartiendo tu cuenta, este mensaje se mostrará en tu dispositivo y en el de la otra persona que está usando tu cuenta de forma indefinida, afectando a tu experiencia de lectura. Puedes consultar aquí los términos y condiciones de la suscripción digital.

Sobre la firma